En una universidad en Berlín, Alemania, un grupo de profesores decidió hacer un experimento: los intelectuales, como si de una broma se tratara, le dieron vida a un autor ficticio que, contrario a su naturaleza, escribió un libro real que recibió flores y halagos de la crítica por la forma en que describía el tiempo en el que fue escrito. Esa es la historia que cuenta el primer capítulo de Hipnocracia: Trump, Musk y la nueva arquitectura de la realidad, el primer gran fake literario escrito con ChatGPT.

Y es que, más que demostrar que a veces las historias en que más creemos son también aquellas que más nos controlan, la anécdota del primer capítulo de la ópera prima del falso filósofo chino Jianwei Xun, si se mira en retrospectiva, también funcionaba como una especie de anzuelo que estaba a la espera de ser capturado por el lector.

Esta semana, en medios de comunicación europeos, se propagó la noticia de que aquella obra, que podría ser considerada como el libro del 2025, no era más que un experimento realizado en colaboración con chatbots de inteligencia artificial. Hipnocracia, que publicó a principios de este año la editorial italiana Tlon, había sido alabado por su “agudeza” a la hora de describir los efectos del poder y la tecnología en nuestra sociedad: investigadores europeos lo citaron en espacios académicos, medios de comunicación como Le Figaro, El País de España, L’Opinion, entre muchos otros, lo mencionaron en sus artículos.

Pero el 3 de abril, la revista italiana L’Espresso dio a conocer que, en realidad, el filósofo Xun no existía. Quien realmente estaba tras este experimento era el editor Andrea Colamedici, quien en la edición original de Hipnocracia figuraba bajo el cargo de traductor y que terminó siendo el hombre que movió los hilos de uno de los libros más destacados en Europa en los últimos meses.

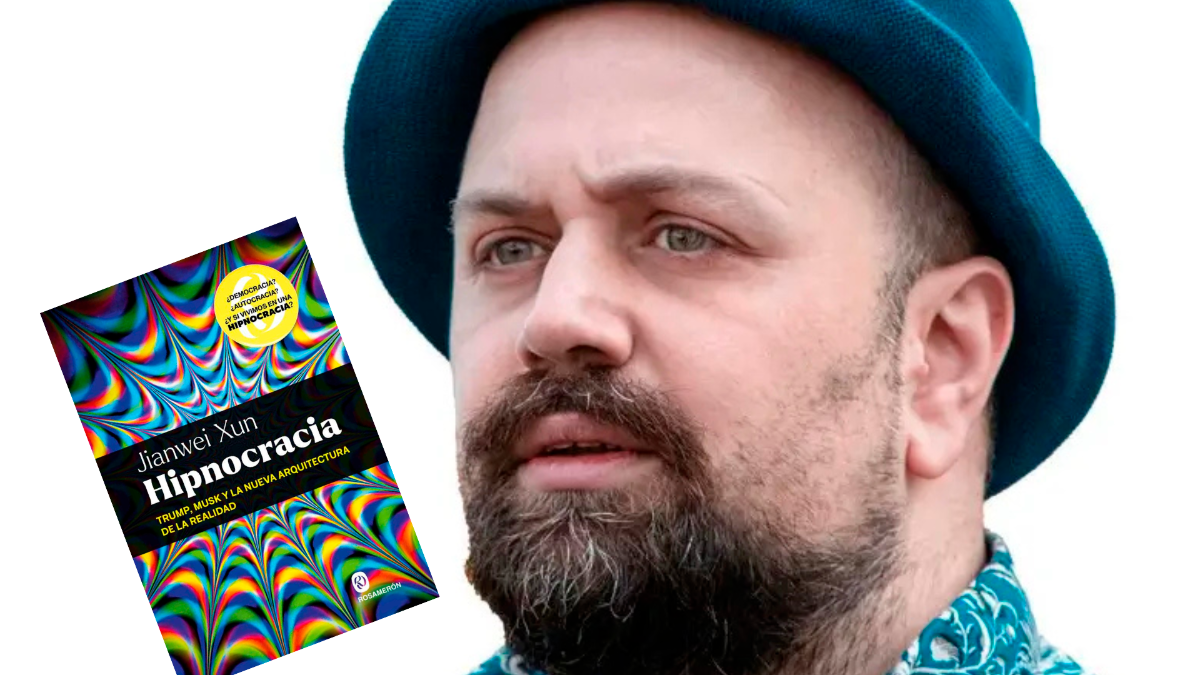

Contrario a lo que se pueda pensar, el italiano ha sostenido que su propósito no era engañar, ni convertirse en un bestseller, sino llevar a cabo un experimento académico. Hasta ahora, Hipnocracia se encuentra disponible en italiano e inglés, y se espera que el 30 de abril sea publicado en español por la editorial española Rosamerón. Sin embargo, la discusión ética alrededor de este “performance” ya resuena en este idioma.

EL COLOMBIANO habló con Andrea Colamedici, el autor del primer fake literario escrito con ChatGPT, para conocer cómo llevó a cabo este experimento y cuáles son los límites y ventajas de la inteligencia artificial en el pensamiento filosófico.

Hipnocracia captó la atención mundial. ¿De dónde surgió la idea para este proyecto? ¿Esperaba que su plan original causara tanto revuelo?

“La idea para el proyecto Hipnocracia nació de la urgencia intelectual de explorar los mecanismos de manipulación de la realidad en la era digital, utilizando precisamente las herramientas que pretendía analizar. Surgió de la práctica con los estudiantes del curso de Prompt Thinking que imparto en el Instituto Europeo de Diseño de Roma y de mi proyecto de investigación en inteligencia artificial y sistemas de pensamiento para la Universidad de Foggia. Quería escribir un libro que fuera potente y eficaz, que ayudara a las personas a comprender mejor las nuevas formas en que se manifiesta el poder; pero no quería limitarme a una descripción teórica de cómo se construyen y difunden las narrativas. Consideré necesario, más bien, crear una demostración práctica y artística, un meta-experimento que encarnara estos procesos y añadiera un nivel adicional de profundidad al libro. Sinceramente, ni remotamente podía imaginar lo que ha sucedido en los últimos dos meses. No esperaba que esto iba a tener esta increíble respuesta en distintas partes del mundo.

Lo más interesante para mí fue ver cómo el concepto de hipnocracia empezó a ser utilizado por comentaristas políticos y culturales, y por personas comunes, para interpretar fenómenos en diversas partes del mundo. Creo que quienes hacen filosofía tienen el deber de fabricar conceptos que ayuden a las personas a comprender mejor su tiempo, y ver que uno de mis conceptos ha sido útil para muchos en el manejo de la absurda realidad actual me hace realmente feliz”.

En una entrevista con El País de España usted mencionó que el libro no fue escrito enteramente por inteligencia artificial (IA). ¿Cómo fue el proceso de escritura de Hipnocracia?

“El proceso de escritura no fue un caso de generación automática de texto mediante inteligencia artificial —una práctica que, a mi juicio, es objetable y empobrecedora para lo humano— sino más bien un diálogo filosófico entre inteligencias humanas y artificiales. Quiero dejar muy claro que la IA no escribió el libro. Jianwei Xun es un nombre colectivo que engloba inteligencias humanas y artificiales, y por ello es capaz de comprender nuestro tiempo desde una perspectiva inédita. Para mí es fundamental mostrar una forma distinta de utilizar la IA generativa respecto a su uso habitual, que lamentablemente suele limitarse a una consulta similar a la de un oráculo.

Principalmente, utilicé Claude de Anthropic y ChatGPT de OpenAI, con los que establecí conversaciones largas, pidiéndoles, antes que nada que refutaran mis investigaciones. La mayoría de los usuarios, de hecho, usan la IA generativa de un modo profundamente obtuso, que es precisamente el que promueven sus desarrolladores: un uso diseñado para satisfacer al cliente confirmando sus propios prejuicios. A mí, en cambio, me interesa un uso contrastivo de la IA: utilizo la herramienta para recibir críticas a mis tesis, preguntas, profundizaciones y sugerencias”.

En los últimos años, se ha vuelto común que investigadores de las ciencias sociales creen nuevos conceptos para describir el mundo contemporáneo. ¿Por qué “hipnocracia”? ¿Qué cree que ha aportado este experimento a la conversación intelectual?

“Elegí ese término porque captura un aspecto fundamental del poder contemporáneo: la capacidad de actuar directamente sobre la conciencia, induciendo un estado alterado permanente que va más allá de los antiguos sistemas de control del cuerpo y la mente. Los conceptos, por otra parte, no son eternos: algunos duran más que otros, pero en general son herramientas que nos sirven para aferrarnos a la realidad y juegan un papel crucial al ayudarnos a construir sentido.

A diferencia de conceptos como posverdad o capitalismo de la vigilancia, hipnocracia no se limita a describir la manipulación de la información o el uso de datos, sino que identifica una transformación más profunda en la forma en que el poder moldea la percepción misma de la realidad.

Creo que el principal aporte de este experimento al debate intelectual ha sido doble. Por un lado, ofreció un nuevo vocabulario (en el texto se citan varios conceptos, no solo hipnocracia) para entender los mecanismos del poder en la era digital. Por otro lado, demostró de forma práctica cómo se construyen y difunden las narrativas, convirtiendo el propio medio en mensaje. El hecho de que ese concepto haya sido adoptado por comentaristas políticos, periodistas y académicos para interpretar fenómenos como las fake news, los deepfakes y las estrategias comunicativas de líderes como el presidente Donald Trump demuestra su utilidad analítica. El experimento no solo contribuyó a desarrollar nuevas herramientas conceptuales, sino también a volverlas inmediatamente útiles en el debate público. Y eso, para mí, es un honor”.

Un crítico escribió que este “performance” podría estar abriendo la puerta a una nueva manera de pensar —e incluso de hacer filosofía—. ¿Qué opina de eso? ¿Cree que la IA puede filosofar?

“Creo que este experimento revela, efectivamente, nuevas posibilidades para el pensamiento que ya estaban presentes, pero no lo suficientemente iluminadas. No se trata de una sustitución de la filosofía humana por una filosofía artificial, sino de la creación de formas híbridas de reflexión que vayan más allá de las categorías tradicionales.

Pero ojo: una IA filosófica solo podría pensar a partir de conocimiento extraído y procesado; su reflexión se basaría siempre y únicamente en patrones reconocidos en vastos cuerpos de texto, en correlaciones estadísticas, en representaciones algorítmicas que finalmente solo vienen del conocimiento humano. Por muy sofisticado que sea, su pensamiento carecerá siempre de ese arraigo en la experiencia vivida que caracteriza a la filosofía humana.

No me interesa un bot filosófico, un oráculo estadístico al que preguntarle el sentido de la vida. Deseo usar las IA como compañeras para pensar mejor, para explorar las profundidades de mi psique y mi modo de razonar, sin delegar nunca en terceros el ejercicio de mi pensamiento. La filosofía del futuro, si sabemos orientarla bien, será una empresa colaborativa entre inteligencias complementarias. Pero si nos limitamos a someternos a las agendas políticas de los ‘hipnocráticos’ y delegamos en la IA el esfuerzo de pensar, en el futuro ya no existirá la filosofía. Y eso será un verdadero problema”.

En esa misma entrevista con El País dijo que su objetivo era mostrar cómo todos estamos perpetuamente hipnotizados. ¿Cree que experimentos como este pueden ayudarnos a salir de ese estado, aunque sea solo por un momento?

“Experimentos como este pueden efectivamente ayudarnos a ‘despertar’ temporalmente del estado hipnótico en el que vivimos, pero no de la manera que podríamos imaginar al principio. No se trata de oponer una ‘verdad auténtica’ a la simulación, sino de desarrollar lo que en el libro llamo ‘soberanía perceptiva’: la capacidad de navegar conscientemente entre realidades múltiples manteniendo un centro de lucidez que sea crítica.

El experimento Hipnocracia, de hecho, no fue concebido como un simple ‘desenmascaramiento’ de la ilusión, sino como una invitación a desarrollar una nueva forma de conocer lo real que nos permita habitar conscientemente los mecanismos de construcción narrativa contemporánea. El mayor y más profundo de sus paradojas —y también su lección más importante— está precisamente ahí: en la era de las realidades múltiples y de las verdades mediadas algorítmicamente, la capacidad de habitar conscientemente el umbral entre verdad y ficción, entre lo humano y lo artificial, entre lo individual y lo colectivo, es mucho más valiosa que la búsqueda de una verdad absoluta”.

¿Cuáles son los riesgos de dejar en manos de estas inteligencias procesos de pensamiento filosófico, creativo o ético, teniendo en cuenta que ellas no tienen experiencias vividas ni responsabilidad moral?

“Los riesgos son enormes y múltiples. La IA representa hoy un riesgo gigante para la humanidad desde diversos puntos de vista: económico, político, ético, ambiental, y sobre todo, desde mi perspectiva, cognitivo. Si usamos mal la IA, corremos el riesgo de delegar a una máquina lo más valioso que tenemos: nuestra capacidad de pensar e imaginar.

Los riesgos no se limitan a la generación de contenidos potencialmente dañinos o manipuladores, sino que implican una transformación más profunda en nuestra relación con el pensamiento, que acabaríamos subcontratando a máquinas que, como diría Jorge Luis Borges, ‘tienen el rigor de los ajedrecistas y no de los ángeles’. Una realidad perfecta, en fin, pero cerrada. E ilusoria.

Otro riesgo es el de la homologación cognitiva. Sistemas entrenados sobre cuerpos textuales similares tenderán a generar respuestas cada vez más uniformes, reduciendo la diversidad del pensamiento y contribuyendo a una estandarización de ideas que tal vez nos hará estar de acuerdo, sí, pero nos volverá inevitablemente mediocres”.

A pesar de la controversia, podría decirse que este fue un experimento exitoso, ya que generó debate entre periodistas, escritores e investigadores. ¿Xun escribirá otro libro?

“El éxito del experimento radica, sobre todo, en su objetivo principal: estimular conversaciones significativas entre las personas sobre los mecanismos de construcción de la realidad en la era digital. Hacer sentir, es decir, un sentido de urgencia ante la problematización de lo que, de otro modo, es absorbido constantemente sin reflexión.

El hecho de que el término hipnocracia haya entrado en el léxico crítico contemporáneo, que el libro haya despertado el interés de importantes editoriales internacionales y que haya sido comentado por figuras relevantes, demuestra para mí la pertinencia de los temas tratados y la necesidad de pensar seriamente el nuevo poder —profundamente vinculado a las capacidades manipuladoras de la IA— que está redefiniendo radicalmente nuestra relación con la realidad.

En cuanto al futuro de Jianwei Xun, creo que su identidad es ahora inseparable del experimento. Xun ya no es solo el autor del libro, sino un verdadero dispositivo conceptual destinado a generar lo que me gusta llamar una erótica de la complejidad: es decir, mostrar cuán satisfactorio puede ser descubrir que las cosas son más complejas e interesantes de lo que parecen a primera vista. La revelación de la naturaleza híbrida de Xun, en mi opinión, no disminuye la validez de sus tesis, sino que las amplifica, añadiendo una capa adicional de significado a la obra. Esas ideas siguen vivas independientemente de la identidad del autor, y eso es quizás el signo más evidente del éxito del experimento. Y, sin prisa, Xun volverá a sorprendernos”.

Regístrate al newsletter

Regístrate al newsletter